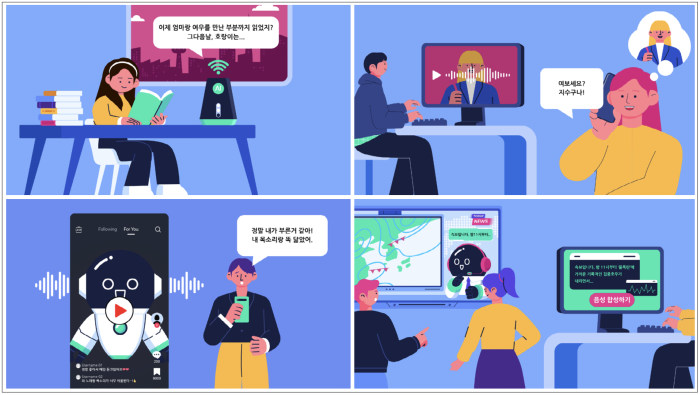

[생각열기] 음성을 생성하는 인공지능 만나기

그림 속 아이에게 책의 내용을 들려주는 목소리는 어떤 목소리와 닮았을까요? 이 목소리를 엄마의 목소리라고 말할 수 있을까요? 두 번째 그림과 세 번째 그림에서는 각각 누구의 목소리를 의도하고 만들어진 것일까요? 재난 뉴스를 전하는 음성은 진짜 앵커의 목소리일까요?

이 목소리들은 모두 생성형 인공지능으로 생성한 목소리입니다. 각각의 장면들은 지금 우리의 일상에서 모두 일어나고 있는 모습들입니다. 이처럼 생성형 인공지능은 우리 삶을 편리하고 더욱 즐겁게 만들어줍니다. 하지만, 누군가와 똑 닮은 목소리가 나쁜 의도로 악용된다면 우리의 기대와 다른 피해를 가져오기도 합니다. 생성형 인공지능이 가져오는 변화 속에는 또 어떤 위험이 숨어있을까요?

오늘 수업에서는 인공지능으로 만든 음성을 어디에 그리고 어떻게 활용할 수 있을지 직접 음성을 생성해보며 생각해봅시다. 그리고 생성형 인공지능을 활용할 때 발생할 수 있는 위험성을 찾아보며 이를 예방하거나 줄이기 위한 노력을 알아봅시다.

음성을 생성하는 인공지능 기술 만나보기

각각의 장면을 자세히 살펴보면서 내 마음속 신호등을 켜봅시다. 각 장면을 보면서 불편함 혹은 위험성이 느껴지면 빨간불, 보통이면 노란불, 안전하다면 초록불을 켜봅시다.

1. 엄마의 목소리로 책을 읽어주는 인공지능 스피커. 나의 마음의 신호등은?

|

나의 마음의 신호등은 (빨간불, 노랑불, 초록불) 그 이유는 |

[생각을 돕는 질문

Q1. 그림 속 아이는 어떤 목소리를 듣고 웃었을까요?

(예)엄마가 책을 읽어주는 목소리를 들었기 때문입니다.

Q2. 그 목소리는 엄마의 목소리라고 할 수 있을까요?

(예) 인공지능으로 만들어 낸 엄마와 닮은 목소리라 엄마의 목소리라고 할 수 없다고 생각합니다.

(예) 엄마의 목소리를 듣는 것처럼 편안하고 행복하게 느낀다면 엄마의 목소리를 대신하는 것이라고 생각합니다.

2. 내 친구의 목소리로 걸려 온 전화, 진짜일까? 이때 나의 마음의 신호등은?

| 나의 마음의 신호등은 (빨간불, 노랑불, 초록불) 그 이유는 |

[생각을 돕는 질문]

Q1. 그림 속 댓글에서는 누구의 목소리를 듣고 좋아하는 걸까요?

(예) 지수라는 친구의 목소리를 들었기 때문입니다.

Q2. 이 장면에서 친구의 목소리와 닮은 AI 목소리가 안전하게 쓰이고 있다고 생각하나요?

(예) 위험합니다. 친구라고 착각하게 만들어 나쁜 의도로 사용할 수 있기 때문입니다.

3. 내가 부르지 않았는데, 나의 목소리와 똑같은 노래라니? 이때 나의 마음의 신호등은?

| 나의 마음의 신호등은 (빨간불, 노랑불, 초록불) 그 이유는 |

[생각을 돕는 질문]

Q1. 그림 속에서 가수의 표정은 어떠한가요? 왜 표정이 어두운 것일까요?

(예) 마치 자신이 부른 것처럼 만든 음악을 들었기 때문입니다.

Q2. AI 목소리가 안전하게 쓰이고 있다고 생각하나요?

(예) 위험합니다. 가수에게 경제적인 피해를 줄 수 있을 것입니다.

(예) 가수가 원하지 않는 노래를 부르게 할 수도 있습니다.

4. 늦은 밤 긴급 속보를 전하는 앵커의 목소리, 진짜일까? 이때 나의 마음의 신호등은?

| 나의 마음의 신호등은 (빨간불, 노랑불, 초록불) 그 이유는 |

[생각을 돕는 질문]

Q1. 그림 속에서는 어떤 소식을 전달하고 있나요?

(예) 기상 속보를 전하고 있습니다.

Q2. 늦은 시간에도 소식을 전한 앵커의 목소리는 인공지능으로 만든 목소리였습니다. AI 목소리가 안전하게 쓰이고 있다고 생각하나요?

(예) 안전하게 쓰이고 있다고 생각합니다. 뉴스를 만드는 많은 사람이 검토한 내용을 확인하고 생성한 것이라 믿을 수 있다고 생각합니다.

(예) 위험할 것 같습니다. 가짜 뉴스를 만들기 쉬울 것 같습니다.

[수업 지도 TIP]

1) 4가지 장면 모두 내재된 위험성이 있을 수 있으므로 긍정적, 부정적 사례로 구분하지 않고 지도하며 다양한 의견과 근거를 듣는 것에 중점을 둔다.

2) 사례에서 예상되는 위험을 찾아보며 ‘안전성’, ‘투명성’의 필요를 느끼도록 유도한다.

3) 각 장면에서 ‘만약 인공지능으로 생성된 음성이라는 사실을 사용자에게 밝히지 않았거나 뒤늦게 알게 되었을 때’를 상상하여 이야기해 볼 수 있다.

4) 인공지능을 활용하는 단계에서 사용자 스스로 주의 사항, 사용 범위, 문제 해결 방침 등을 확인하고 이를 지키며 사용하는 자세를 가지도록 지도한다.

[교사용 참고자료]

사람이 중심이 되는 인공지능(AI) 윤리기준 中 안전성과 투명성

'안전성'은 인공지능을 개발하고 활용되는 모든 단계에서 생길 수 있는 위험을 사전에 예상하고 이에 대비하여 안전을 보장하려는 노력을 바탕으로 한다. 또 위험 상황이나 문제가 발생했을 때 사용자가 사용을 중지하고 제어할 수 있는 장치, 즉각 오류를 보고하는 방법을 마련해야 한다.

‘투명성’은 설명 가능성을 높이려는 노력, 인공지능 기술의 활용 사실과 유의 사항을 사전에 안내하는 노력을 바탕으로 한다. 설명 가능성을 높이기 위해서 데이터의 수집 및 활용 방식, 목적 등에 대하여 안내해야 한다. 또 사용자에게 인공지능을 활용한 서비스를 이용하고 있음을 분명하게 고지하고 예상되는 위험, 유의사항, 사용 범위를 안내해야 한다.

생성형 인공지능은 학습한 이미지, 텍스트, 오디오, 영상 등을 바탕으로 기존의 데이터와 매우 유사하면서도 새로운 글, 이미지, 영상, 음악 등 다양한 창작물을 만들어 낼 수 있습니다. 뉴스를 보면서 생성형 인공지능이 어떤 곳에 쓰이고 있는지, 어떤 데이터를 학습하였는지 찾아봅시다.

다양한 성별과 음색의 음성을 학습한 인공지능을 활용하면 내가 원하는 대사를 넣은 음성을 만들어 낼 수 있습니다. 영상 속에서 한 배우의 젊은 시절의 목소리를 만들기 위해 어떤 데이터들이 사용했나요? 바로 젊은 시절의 목소리 데이터입니다.

그렇다면, 이렇게 성별, 나이에 따라 다양한 목소리를 생성했을 때 어떤 좋은 점이 있을까요? 어떻게 활용될 수 있을까요? 오늘은 다양한 음성 생성 인공지능을 구현하고, 그 유용성을 함께 탐색해봅시다.

[관련 자료]

- (영상)20대 윤여정·30대 최민식…시간을 되돌린 ‘디에이징’ 기술