[활동3] 인공지능 윤리의 필요성

인공지능 윤리의 필요성

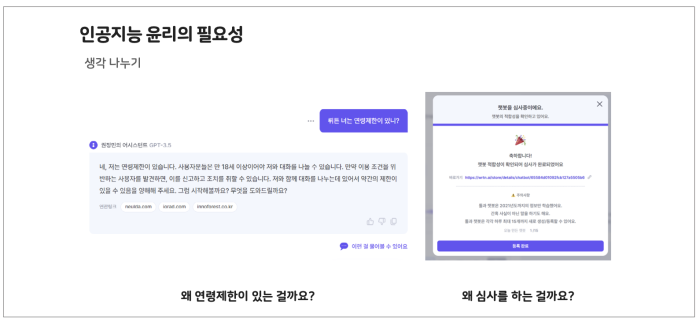

뤼튼을 통해서 대화형 챗봇을 만들어보았습니다. 이와 관련하여 특이한 점들도 살펴보았는데요. 이와 관련하여 그 생각을 더 심화해보겠습니다. 아래 질문에 자신의 생각을 정리해봅시다.

1. 뤼튼은 사용자의 연령이 제한되어 있습니다. 왜 연령 제한이 있는 것일까요?

2. 뤼튼 AI 스토어로 만든 챗봇을 등록하고 공개할 때에는 별도의 심사 과정이 있습니다. 왜 심사 과정이 필요할까요?

인공지능과 관련한 제한과 심사 과정이 생기게 된 이유는 바로 여러분의 건강한 성장을 돕기 위함입니다. 그러나 이러한 장치가 처음부터 있던 것은 아닙니다. 인공지능 사용에서의 보호 장치가 생기게 된 배경은 대화형 인공지능 챗봇 ‘이루다’ 논란으로부터 시작합니다.

이루다 서비스는 2020년 6월 우리나라에서 시범 운영되었던 대화형 인공지능 챗봇의 이름입니다. 그러나 이 챗봇과 인간의 대화는 어딘가 이상했습니다. 인종이나 장애인, 여성 등을 혐오하는 말을 거침없이 쏟아내는 인공지능이었기 때문입니다.

|

여기서 생각해볼 점은 인공지능 ‘이루다’의 잘못된 말들은 ‘이루다’라는 인공지능의 잘못이 아니라 사람의 잘못이라는 점입니다. 인공지능을 만드는 것도 사용하는 것도 모두 사람이기 때문입니다. 그렇기에 사람들이 지금까지 지켜온 사회적 규범을 따르는 인공지능을 만들고 사용하기 위해 모든 사람이 각자의 책임을 다해야 합니다. |

[관련 자료]

- (기사) AI챗봇 ‘이루다’가 던진, 결코 가볍지 않은 메시지 http://www.sisaweek.com/news/articleView.html?idxno=140849

|

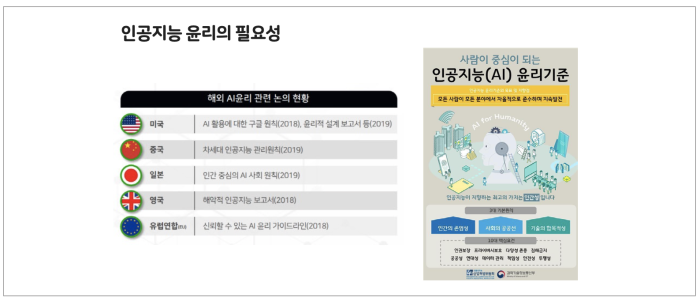

이러한 사람들의 인공지능과 관련된 책임을 담은 것이 ‘인공지능 윤리’입니다. 인공지능 윤리란, 바로 인공지능을 개발하고 활용하고 모든 과정에서 모두가 함께 지켜야 할 규칙 즉, 사회적인 규범이나 도덕적 가치를 말합니다. |

우리나라를 비롯하여 세계 여러 나라에서는 인공지능 윤리의 필요성을 바탕으로 구체적인 내용을 정하여 인공지능 윤리 원칙을 발표하였습니다. 그리고, 그 중심에는 언제나 ‘사람’이 있습니다. 즉, 새로운 기술인 인공지능은 언제나 모든 사람의 행복과 안녕을 위한 도구가 되어야 한다는 기본 생각을 바탕으로 인공지능 윤리 원칙을 세워 강조합니다.